Cuando compras algo online, cuando ves una película en una plataforma SVOD, cuando escuchas una canción en una aplicación de música en streaming: sin que necesariamente te des cuenta, los algoritmos te acompañan a lo largo de tu viaje hacia la oferta cultural. E influenciarte en tus compras o tus elecciones culturales.

Ya sea en Amazon, Spotify, Netflix o Steam (el ASNS), los motores de recomendación lo llevarán a contenido popular, visto y compartido. Con el postulado de partida de que ante la sobreabundancia de opciones puede ser útil asesorarse con herramientas que nos “filtren” el contenido.

- Netflix, Disney+, Stadia, Facebook... ¿demasiadas opciones, matando la elección?

Ante la parálisis y el estrés que provoca la inmensidad de los catálogos de Spotify o Netflix, los algoritmos te tranquilizan, y te ahorran tiempo. Saber que el tiempo también es dinero: no es casualidad que el sistema de recomendaciones de Amazon sea la base de su modelo de negocio. Según la plataforma de comercio electrónico, para quien el tiempo dedicado a elegir es tiempo de consumo desperdiciado, el 30% de las páginas vistas en su sitio provienen de sus sugerencias algorítmicas.

Aún más fuerte en Netflix, que se jacta de que el 75% del contenido visto por sus clientes proviene de una recomendación personalizada de su algoritmo. Et le plus beau, c'est que les utilisateurs eux-mêmes sont contents d'être influencés par les algorithmes : selon une étude menée en 2015 par la CNIL, 9 utilisateurs des services de streaming sur 10 considèrent que leurs données sont utilisées pour améliorer el servicio. Y el 65% escucha las recomendaciones del algoritmo. La tasa sube al 68% entre los usuarios de servicios de vídeo como YouTube o Netflix.

Prisioneros de nuestros dobles digitales

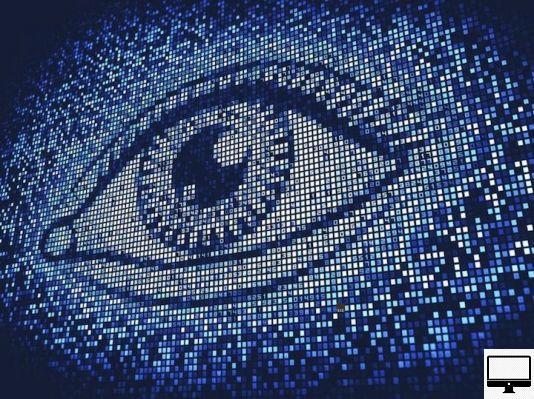

Las críticas que apuntan a las "burbujas de filtro" creadas por los algoritmos no conciernen solo a Facebook: las de la ASNS también nos encierran en algunos de nuestros gustos, y en definitiva impiden que "salgamos de nuestra zona cultural de confianza". famosos algoritmos, que no son más que conjuntos de reglas de cálculo que se utilizan para resolver problemas matemáticos, se utilizan aquí para filtrar constantemente, cuando estamos en línea, piezas de información (películas, música, libros, imágenes, páginas web) Para ello, utilizan dos recursos: el comportamiento de navegación del usuario de Internet (palabras clave de búsqueda, historial de uso, comportamiento de consumo) y recomendaciones sociales colaborativas, que se basan en el comportamiento del usuario "me gusta".

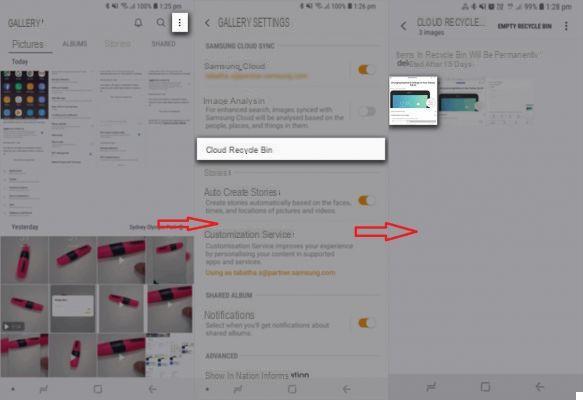

Todos estos datos, una vez mezclados, forman "datos culturales personales"; reflejan tus elecciones y, gracias a la IA, permiten que los sistemas de recomendación se adapten a tus gustos (que pueden cambiar). Netflix, por ejemplo, utiliza algoritmos para cambiar las miniaturas de películas o series que se muestran en su página de inicio, según el historial de uso del suscriptor: para la misma película, el cartel utilizado puede parecerse al de un thriller, una película de terror, un romance , o una comedia. Lo que significa que cuando estás en Netflix pensando que estás haciendo tu propia selección, tu sensación de tener una opción o poder elegir "por casualidad" es solo una ilusión. En realidad eres un prisionero de tu doble digital, que te ha encerrado en tu burbuja de filtro cultural.

Nuestros gustos son manipulables…

Pero las herramientas de recomendación no solo son capaces de influir en nuestras elecciones: también pueden modificar nuestros gustos, en sustancia. Esta es la conclusión de un experimento de economía del comportamiento, publicado en MIT Sloan en 2020, titulado "Los efectos secundarios de los sistemas de recomendación". Un equipo de investigadores estadounidenses pidió a 169 estudiantes (y ávidos consumidores de música) que escucharan los primeros 30 segundos de docenas de canciones.

Cada uno de ellos recibió una puntuación de entre 1 y 5 estrellas. Se les dijo a los estudiantes que estos puntajes se calcularon a partir de sus preferencias pasadas. Mientras que en realidad, esta notación se generó de forma completamente aleatoria. Al final de la prueba, los investigadores les preguntaron si estaban listos para comprar canciones, y cuáles, para escucharlas por completo. Resultado: por cada punto de calificación adicional, la disposición a pagar de los cuyes aumentó de 12% a 17%. Y, sin embargo, estos puntajes de ninguna manera reflejaron sus preferencias.

Los consumidores prefieren que el sistema les diga lo que les gustaríaConcretamente, les guiamos, pues, haciéndoles creer que ya les gustaba tal o cual canción, y al final, su deseo de compra era mucho mayor. Los conejillos de indias se sienten casi "forzados" a que les guste una pieza musical cuando una herramienta de recomendación (aquí manipulada) se lo dice. "Les consommateurs ne se contentent pas de préférer ce qu'ils ont expérimenté et savent qu'ils apprécient ; ils préfèrent ce que le système leur a dit qu'ils aimeraient. Cela est surprenant, car les consommateurs ne devraient pas avoir besoin d' un système pour leur dire à quel point ils ont apprécié une chanson qu'ils viennent d'entendre. L'avènement des systèmes de recommandation peut nous amener à nous interroger sur nos propres goûts. Nous passerons de la question 'Est-ce que j 'Gustar ?' a la pregunta '¿Debería gustarme esto?'", escriben los investigadores.

Para los autores del estudio, esta experiencia muestra el "lado oscuro" de los motores de recomendación: la existencia de posibles sesgos de decisión, introducidos por los algoritmos. Y la capacidad de estos sistemas de manipular nuestras preferencias, nuestros gustos, sin que realmente nos demos cuenta. "Después de todo, los detalles detrás de los algoritmos de recomendación están lejos de ser transparentes. Los motores de recomendación defectuosos que estiman incorrectamente las verdaderas preferencias de los consumidores corren el riesgo de reducir la disposición a pagar por ciertos artículos y aumentar por otros, independientemente de la probabilidad de una coincidencia real.

Esto puede alentar a las organizaciones menos éticas a inflar artificialmente las recomendaciones”, escriben. Y más allá de la “manipulación directa” de las reseñas falsas, también existe el riesgo de un “error aleatorio”. Los algoritmos pueden estar equivocados y hacer evaluaciones exageradas; al sobrestimar el valor. de un producto, o por el contrario, al subestimarlo, pueden incitar a un consumidor a comprar algo que de otro modo nunca habría comprado (pero al final se sentirá decepcionado), o "desviarlo" del contenido que podría de lo contrario han consumido.

…Porque dependen de los demás

Entonces, ¿debemos preocuparnos y tener miedo de que nos manipulen cuando vamos a Netflix, Amazon o Spotify? Un profesor de psicología social, Stéphane Laurens, refuta la idea de tal "peligro de manipulación" por parte de los algoritmos: según él, la influencia de los motores de recomendación es en realidad un fenómeno tan antiguo como el comercio. Lo que hoy en día está automatizado por algoritmos, antes lo hacían los humanos: "Los vendedores aconsejan a sus clientes con frases como 'te quedará bien'; los anuncios dicen 'te encanta...' y muestran a personas encantadas con el producto. Las estrellas vinculados a los productos son la contrapartida de estos consejos en los sitios, consejos elaborados a partir de pistas dadas por perfiles, compras o consultas, similares a las pistas que damos para ver a un vendedor cuando entramos en su tienda y hablamos con él por unos momentos", explica. En definitiva, los sistemas de recomendación no son más que la versión high-tech de ciertos vendedores, esos que son tan buenos que son capaces, a través de sus consejos, de hacerte comprar cosas que no te gustan, y de pesar sobre tus gustos. Vendedores humanos que también elaboran sus recomendaciones a partir de las pistas que les dejamos, de nuestros hábitos y de lo que compran otros clientes que creen que son como nosotros.

Nos arrullamos en la ilusión de tomar nuestras propias decisiones de manera autónoma y objetiva.Pero Stéphane Laurens va más allá: para él, no son simplemente nuestros gustos por los productos manipulables, sino “la idea que tenemos de nosotros mismos”. Se basa en la investigación de la psicóloga Hazel Markus sobre el "autoesquema", un concepto que sugiere que los individuos construyen autoesquemas de sí mismos, representaciones que utilizamos para describirnos a nosotros mismos (soy extrovertido, soy sincero, soy creativo). Según Markus, si a un individuo se le da información ficticia sobre su personalidad, información que es muy diferente de lo que la persona piensa de sí misma (por ejemplo, soy introvertido, hipócrita y cartesiano), y que se le dice que proviene del resultados de una prueba clínica y científica seria, influirá significativamente en la forma en que se percibirá a sí mismo. "El motor de recomendaciones dice que disfrutarás de esta pieza, la prueba dice que eres una persona independiente... y la gente no ignora esta información: nuestras opiniones y gustos no son solo fruto de nuestras propias experiencias, dependen de lo que otros nos dicen sobre nosotros mismos y los objetos que nos rodean", señala Stéphane Laurens.

Finalmente, lo que nos muestran todos estos estudios no es que seamos manipulados constantemente; sino que estamos adormecidos en la ilusión de tomar nuestras propias decisiones de manera autónoma y objetiva. “Tomando esta ilusión como punto de partida, tales resultados parecen mostrar que en cuanto damos una recomendación o la opinión de otros, el individuo abandona su juicio inicial si lo tuviera, no analiza la realidad y cambia para seguir la recomendación o Esto equivale a ver juicios inestables, individuos que no mantienen sus posiciones, que cambian sin razón… Aparecen entonces como consumidores imbéciles cuyo tiempo ha sido hábilmente captado por el cerebro disponible para manipularlos”, concluye la investigadora en psicología social. Esto no quiere decir que seamos necesariamente ovejas manipulables, sino simplemente que somos seres profundamente sociales, y que nuestros juicios son inestables, algoritmos o no.

Recrea la aleatoriedad

Pero, entonces, ¿cómo podemos salir de nuestras burbujas culturales, liberarnos de esta ilusión del libre albedrío y reducir todos estos sesgos? El sociólogo Dominique Cardon, autor del libro “Con qué sueñan los algoritmos”, sugiere que podríamos introducir el elemento humano en las propuestas editoriales de las plataformas de streaming, por ejemplo. O mejore la comprensión de todos los mecanismos informáticos y la capacidad de "volver al manual". En otras palabras, aprender a "levantar el capó" y explicar cómo funcionan los algoritmos.

Pero también podríamos recrear la aleatoriedad, la aleatoriedad real; como el “Comprador aleatorio”, diseñado por el desarrollador Darius Kazemi. Un bot que (en realidad) hace una selección aleatoria, para un presupuesto determinado, en Amazon. Esto también es lo que ofrece Forgotify, un sitio dedicado únicamente a canciones nunca escuchadas en Spotify. Utiliza un programa que te permite escuchar canciones en esta plataforma que solo han sido escuchadas por sus creadores. Para salir de las burbujas algorítmicas y no dejarnos influenciar, sería posible desenterrar contenidos desconocidos, poco escuchados/vistos/leídos. Sumergiéndonos en lo que algunos llaman la "web solitaria" - o "web solitaria", pero esa es otra historia, que les contaré la semana que viene, en otro artículo.